YoloV8 문서 따라해보기

YoloV8 문서를 보면

Train -> VAL -> Predict -> Export 순으로 되어있다.

모델을 학습하고 검증하는 과정은 우선 추후에 올리고

가장 재미있는 과정인 예측 하는 결과를 확인해보자

목차

-

- [기본 환경 세팅]

-

- [Pose 데이터 활용해보기]

0. 가상환경 키기

conda activate yolov8_custom

이전 포스팅을 참고하여 이미 설치된 가상환경을 활성화 해줍니다.

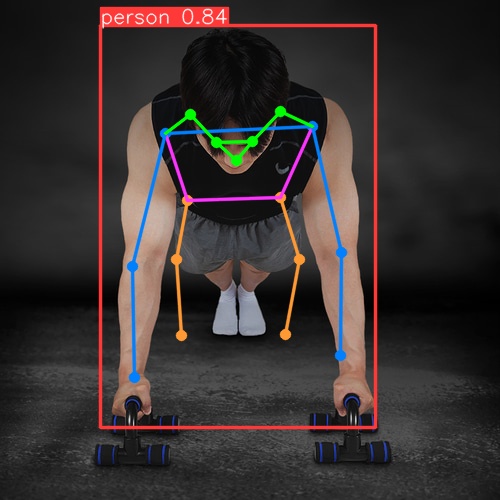

1.Pose 데이터 활용해보기

- 기본 스크립트 ```python from ultralytics import YOLO

Load a model

model = YOLO(‘yolov8n-pose.pt’) # load an official model

Predict with the model

results = model(‘https://ultralytics.com/images/bus.jpg’) # predict on an image

python 스크립트만 입력해줘도 모델이 없으면 찾아서 업데이트 작업 진행해주고 참 좋은 기능이다.

다만 해당 기본 스크립트는 결과 파일을 보여주지 않기 떄문에 조금에 수정을 해준다

2. 결과 영상 출력하기

```python

from ultralytics import YOLO

import cv2

# Load a model

model = YOLO('yolov8n-pose.pt') # load an official model

# Predict with the model

model.predict(source = 'https://ultralytics.com/images/bus.jpg', show = True, save=True)

cv2.waitKey(0)

결과

- 개발 환경 목록

출처

- yoloV8 포즈 자세 https://docs.ultralytics.com/tasks/pose/#train

댓글남기기